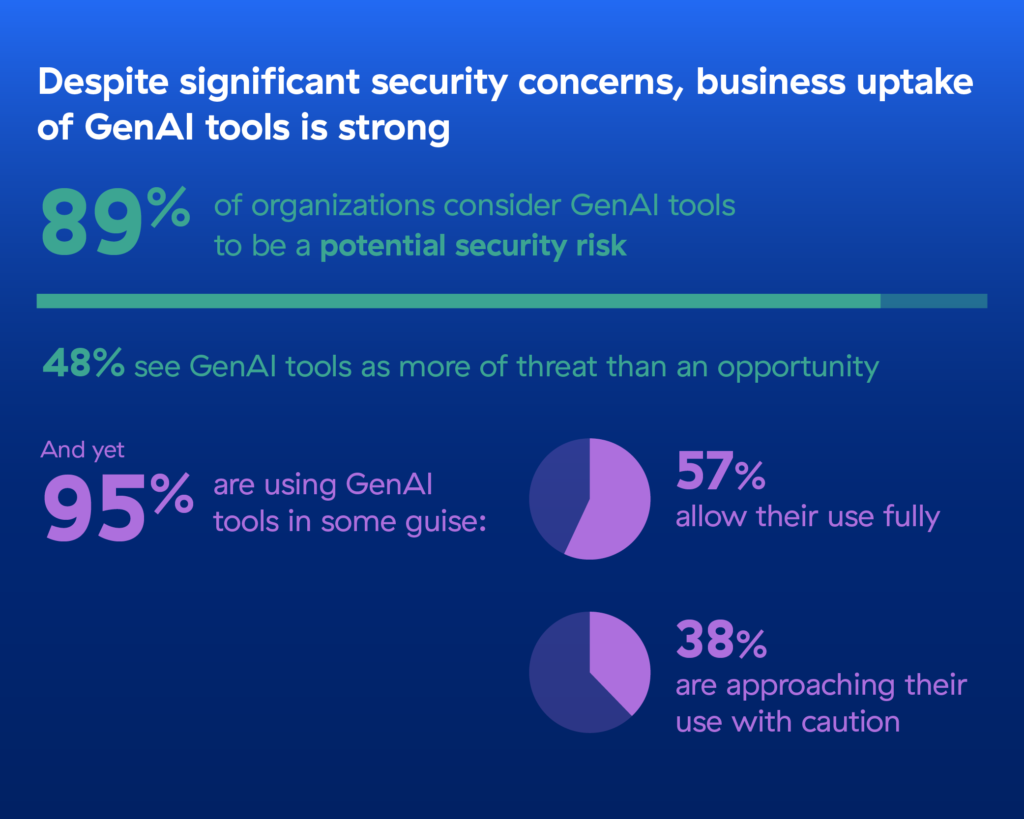

La nuova ricerca di Zscaler “Occhi puntati sulla sicurezza della GenAI" svela come le aziende sentano fortemente la pressione nell’accelerare sull’utilizzo di strumenti di intelligenza artificiale generativa (GenAI), nonostante i notevoli problemi di sicurezza legati al suo utilizzo.

Dalla survey, che ha coinvolto oltre 900 Reponsabili IT a livello internazionale, emerge che sebbene l'89% delle aziende consideria gli strumenti di GenAI come ChatGPT un potenziale rischio per la sicurezza, il 95% li sta già utilizzando in qualche modo all'interno della propria azienda.

Ancora più preoccupante è il dato che rileva come il 23% degli intervistati non stia monitorando affatto l'utilizzo di questi strumenti e il 33% non abbia ancora implementato alcuna misura di sicurezza aggiuntiva legata all’utilizzo della GenAI, anche se molti l'hanno pianificato.

La situazione appare particolarmente evidente tra le aziende di piccole dimensioni (500-999 dipendenti), dove lo stesso numero di aziende sta utilizzando strumenti di GenAI (95%), ma ben il 94% riconosce che sia rischioso.

Serve colmare il divario tra utilizzo e sicurezza

A fronte del 51% degli intervistati che prevede un aumento significativo dell'interesse per gli strumenti di intelligenza artificiale generativa entro la fine dell'anno, le aziende devono agire rapidamente per colmare il divario tra utilizzo e sicurezza.

Ecco alcune misure che i dirigenti aziendali possono adottare per garantire che l'uso degli strumenti di intelligenza artificiale generativa nella loro azienda sia adeguatamente protetto:

- Implementare un'architettura Zero Trust globale per autorizzare solo applicazioni AI e utenti approvati.

- Eseguire valutazioni approfondite dei rischi per la sicurezza delle nuove applicazioni di AI per comprendere chiaramente e le vulnerabilità e agire di conseguenza.

- Creare un sistema di registrazione completo per tenere traccia di tutte le richieste e le risposte dell'AI.

- Attivare misure di prevenzione della perdita di dati (DLP) Zero Trust per tutte le attività di AI per proteggersi dall'esfiltrazione dei dati.